Jeder Vierte nutzt Plapper-KI ChatGPT

TÜV-Umfrage: 2/3 halten Technologie für kaum beherrschbar

Berlin, 14. Mai 2023. Künstliche Intelligenzen (KI) beeinflussen immer spürbarer unseren Alltag – neuerdings vor allem die Plapper-KIs: Fast jeder vierte Deutsche hat mittlerweile bereits die Dialog-KI „ChatGPT“ für berufliche oder private Zwecke eingesetzt. Das hat eine Forsa-Umfrage im Auftrag des Prüf-Dachverbandes „TÜV“ aus Berlin ergeben.

Malen, programmieren, schummeln

Manche nutzen Künstliche Intelligenzen, um Bilder zu generieren. Andere suchen etwas Unterhaltung. Wieder andere spannen sie ein, um ihnen Hausaufgaben aufzuhalsen oder einfache Programmieraufgaben an sie weiterzudelegieren – und die Breite der praktischen Anwendungen wächst Woche für Woche. „Seit seiner Einführung zeigt ChatGPT eindrucksvoll, welches enorme Potenzial Künstliche Intelligenz hat“, betont TÜV-Verbands-Chef Joachim Bühler. „ChatGPT zeigt aber auch, welche Risiken mit dem Einsatz von Künstlicher Intelligenz verbunden sind.“

TÜV dringt auf TÜV-Siegel für KIs

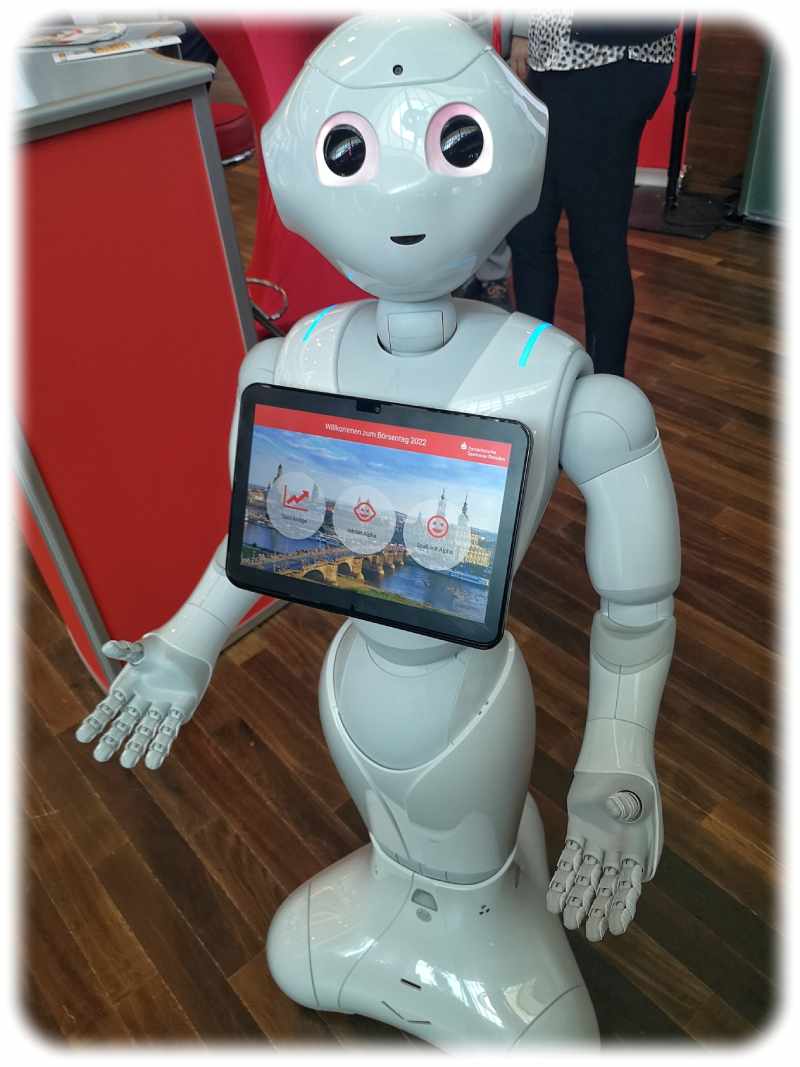

Denn immerhin 80 Prozent der Befragten halten die Risiken beim KI-Einsatz für kaum abschätzbar. Knapp zwei Drittel befürchten, dass die Technologie für Menschen nicht mehr beherrschbar ist. Und 84 Prozent fordern gesetzliche Vorgaben für KI-Anwendungen. In diese Kerbe haut auch der TÜV – nicht ganz uneigennützig – seit geraumer Zeit und fordert verbindliche Test-Vorgaben und Prüfsiegel für Künstliche Intelligenzen. „Vor ihrer Markteinführung sollten alle Hochrisiko-KI-Systeme von einer unabhängigen Stelle überprüft werden“, fordert Bühler. „Nur so kann sichergestellt werden, dass die Anwendungen den Sicherheitsanforderungen entsprechen.“ Er denkt da zum Beispiel an kritische Infrastrukturen, den KI-Einsatz in automatisierten Fahrzeugen, bei medizinischen Diagnosen, für Software im Personalwesen oder bestimmte KI-basierte Roboter. Die TÜV-Unternehmen haben dafür inzwischen ein „TÜV AI Lab“ gegründet, während der Dachverband derzeit „AI Quality & Testing Hubs“ einrichtet.

Europa werkelt an KI-Gesetz

Auch die EU ist seit geraumer Zeit dabei, KI-Technologien durchzuregulieren. Die Ausschüsse des EU-Parlaments beraten derzeit den Entwurf für einen „AI Act“. Der sieht laut TÜV-Angaben vor, KI-Anwendungen in vier Risikoklassen einzuteilen. „Die geplanten Regelungen reichen von einem Verbot für KI-Anwendungen mit einem ,unannehmbaren Risiko’ wie zum Beispiel Social Scoring bis zu keinerlei Vorgaben für Anwendungen mit ,minimalem Risiko’ wie Spamfiltern oder Games. KI-Systeme mit einem ,begrenzten Risiko’ wie einfache Chatbots müssen bestimmte Transparenz- und Kennzeichnungspflichten erfüllen. Für KI-Anwendungen mit einem ,hohem Risiko’, zum Beispiel in kritischen Infrastrukturen, Software im Personalwesen oder bestimmte KI-basierte Roboter, gelten strenge Sicherheitsanforderungen. Diese müssen neben Transparenzpflichten auch Anforderungen wie die Erklärbarkeit ihrer Ergebnisse oder Diskriminierungsfreiheit erfüllen.“

In der TÜV-Umfrage hat die EU mit ihrer Regulierungs-Offensive im Grundsatz auch eine breite Mehrheit hinter sich: 91 Prozent fordern, dass der Gesetzgeber einen rechtlichen Rahmen für den sicheren Einsatz von KI schaffen sollte.

Autor: hw

Quellen: TÜV-Verband, eur-lex.europa.eu, Oiger-Archiv

Ihre Unterstützung für Oiger.de!

Ohne hinreichende Finanzierung ist unabhängiger Journalismus nach professionellen Maßstäben nicht dauerhaft möglich. Bitte unterstützen Sie daher unsere Arbeit! Wenn Sie helfen wollen, Oiger.de aufrecht zu erhalten, senden Sie Ihren Beitrag mit dem Betreff „freiwilliges Honorar“ via Paypal an:

Vielen Dank!