Gehackte Roboter helfen Cyber-Einbrechern

Mitarbeiter ließen Sozialrobot in gesicherte Bereiche durch

Ingolstadt/Gent, 15. Oktober 2019. Hacker können Sozialroboter so manipulieren, dass sich damit physischen Zugang zu gesicherten Bereichen bekommen sowie Informationen ergaunern, die beim Passwort-Klau helfen. Das haben Forscher der Uni Gent und der russischen Sicherheits-Softwareschmiede „Kaspersky“ durch Experimente und Analysen nachgewiesen.

40 Prozent winkten den Roboter durch

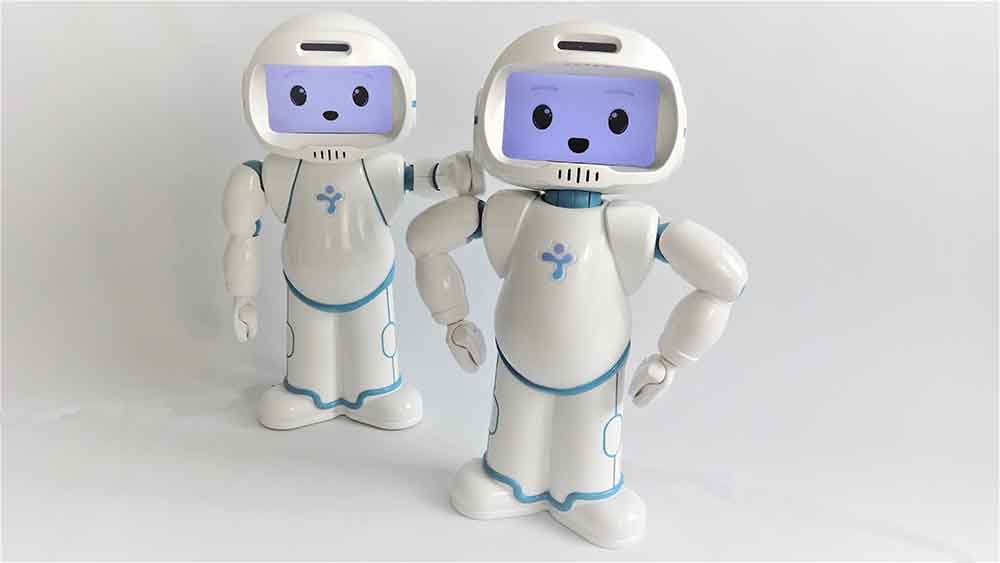

Für ihre Untersuchung nutzten die Experimentatoren einen Roboter, der darauf spezialisiert ist, mit Menschen zu sprechen und auch nonverbal zu interagieren. Diesen Sozialroboter stellten sie vor ein Mehrzweckgebäudes in der Innenstadt von Gent in Belgien. Der Roboter sprach dann Mitarbeiter an, ob er ihnen durch die Tür folgen dürfe. 40 Prozent der Angesprochenen ließen den Roboter dann auch hinein, obwohl der Roboter dafür eigentlich einen Sicherheitsausweis am Kartenleser hätte vorlegen müssen.

Als Pizza-Roboter war’s noch leichter

„Als der Roboter als Pizzalieferant positioniert wurde und eine Schachtel einer international bekannten Take-away-Marke in der Hand hielt, akzeptierten die Mitarbeiter die Rolle des Roboters und schienen noch weniger geneigt zu sein, seine Anwesenheit oder seine

Gründe für den Zugriff auf den gesicherten Bereich in Frage zu stellen“, berichtet die deutsche Niederlassung von Kaspersky in Ingolstadt.

Angesprochene verplappern sich

Außerdem gelang es den Roboter, mehrere Leute in freundschaftliche Gespräche zu verwickeln, bei denen er deren Geburtsdatum, das Fabrikat des ersten Autos oder die Lieblingsfarbe erfuhr. All dies sind Informationen, mit denen sich oft Passwörter ändern lassen. „Mit Ausnahme eines einzigen Teilnehmers gelang es den Forschern, personenbezogene Daten mit einer Geschwindigkeit von etwa einer Information pro Minute von jedem der Teilnehmer zu erhalten.“

Menschen neigen dazu, Robotern zu vertrauen

„Aus der wissenschaftlichen Literatur geht hervor, dass das Vertrauen in Roboter und insbesondere in soziale Roboter vorhanden ist und dazu verwendet werden kann, Menschen zu bestimmten Handlungen zu überreden, oder Informationen preiszugeben“, warnte Robotik- Professor Tony Belpaeme von der Universität Gent. „Je menschlicher der Roboter ist, desto größer ist im Allgemeinen seine Überredungs- und Überzeugungskraft. Unser Experiment hat gezeigt, dass dies erhebliche Sicherheitsrisiken mit sich bringen kann.“

Robot-Software leicht knackbar

Zudem untersuchten die Analytiker, wie schwer oder leicht es ist, einen typischen Sozialroboter zu hacken. „Wir haben die Software untersucht, die bei der Entwicklung von Robotersystemen verwendet wird“, erzählt Kaspersky-Sicherheitsforscher Dmitry Galov. „Interessanterweise haben wir festgestellt, dass Entwickler bewusst Sicherheitsmechanismen

ausschließen und sich stattdessen auf die Entwicklung von Komfort und Effizienz konzentrieren.“

Erklärvideo von "Tomorrow Unlocked" zum Sozialroboter- Experiment:

Fazit:

Angreifer können soziale Roboter relativ leicht umprogrammieren und dann einsetzen, um Sicherheitsbarrieren zu überwinden. Die Studienautoren plädieren dafür, solche Sicherheitslücken in der Robotik zu schließen.

Autor: hw

Quelle: Kaspersky

Ihre Unterstützung für Oiger.de!

Ohne hinreichende Finanzierung ist unabhängiger Journalismus nach professionellen Maßstäben nicht dauerhaft möglich. Bitte unterstützen Sie daher unsere Arbeit! Wenn Sie helfen wollen, Oiger.de aufrecht zu erhalten, senden Sie Ihren Beitrag mit dem Betreff „freiwilliges Honorar“ via Paypal an:

Vielen Dank!